Sinaloa se convirtió en el primer estado en México en aprobar por unanimidad reformas a su Código Penal para sancionar a quienes utilicen la Inteligencia Artificial (IA), para transmitir, intercambiar o distribuir imágenes, audios o videos con contenido sexual que afecten la intimidad de las personas sin su consentimiento. Las sanciones van de 500 a mil días de multa hasta penas de 3 a 6 años de prisión contra los responsables.

Las reformas al Artículo 185 Bis del Código Penal de Sinaloa para regular el uso de la IA, impulsadas por la diputada Cinthia Valenzuela Langarica son un primer paso —al menos a nivel local— para darle un mejor uso a las nuevas herramientas digitales garantizando transparencia, consentimiento y la seguridad y protección de datos personales. Al respecto, la diputada Elizabeth Chia Galaviz señaló que, con esta nueva revolución de internet, las mujeres enfrentan una creciente amenaza de intromisión a la intimidad.

“Violar la intimidad sexual de las mujeres, causa un daño psicológico y emocional que refuerza los prejuicios, daña la reputación, genera pérdidas económicas y plantea barreras a la participación en la vida pública”. (Diputada Elizabeth Chia Galaviz)

Regulación de la IA en México

De acuerdo con la senadora Alejandra Lagunes, integrante de la Comisión de Derechos Digitales del Senado de la República, en México existen 19 iniciativas para regular distintos aspectos de la Inteligencia Artificial. La mayoría de estas propuestas se centran en modificaciones en el Código Penal Federal que buscan la tipificación de delitos relacionados con la IA.

Entre estas iniciativas se encuentra la propuesta del diputado federal Miguel Torruco, en la que se contemplan penas de hasta ocho años de cárcel para quien use los algoritmos de IA con el fin de cometer fraude o dañar la imagen de cualquier persona física o moral. Además, en mayo de 2023, el congresista Ignacio Loyola, propuso crear una nueva institución gubernamental, encargada de establecer normas oficiales que promuevan el desarrollo ético de la tecnología.

Aunque existen iniciativas respecto al tema e incluso se realizaron mesas de análisis sobre la regulación ética de la Inteligencia Artificial en el país, hasta el momento no existe un marco jurídico federal al respecto, pues las propuestas no han sido discutidas y las conclusiones del trabajo de los especialistas que participaron durante las mesas de análisis se publicaran en la RAM de la UNESCO y se compartirán con las candidatas y el candidato a la presidencia de México para que, quien sea la persona electa decida como regular la IA en el país.

Foto: Cuartoscuro

Taylor Swift y Rosalía víctimas de la IA

Los casos de personas cuya imagen y voz han sido manipuladas para cometer fraudes o con fines de violencia sexual se han viralizado en diversos países, el caso más reciente es el de Taylor Swift, de quien se compartieron imágenes intimas creadas con Inteligencia Artificial en la red social X. Aunque X tomó medidas al respecto bloqueando la búsqueda de Taylor y declaró que está prohibido publicar desnudez no consentida lo cierto es que las imágenes fueron vistas por millones de personas antes de ser eliminadas de las redes sociales.

De acuerdo con una revisión de Bloomberg, no es la primera vez que la imagen de Taylor Swift es manipulada con Inteligencia Artificial: los 10 principales sitios web deepfake albergaban alrededor de mil videos que hacían referencia a la cantante a finales de 2023. La persistencia de este contenido en internet visibiliza que continúa circulando en canales menos regulados.

Hasta el momento la cantante no ha dado una respuesta pública al respecto, sin embargo, sus seguidores e incluso la Casa Blanca han salido en su defensa; la secretaria de prensa de la Casa Blanca, Karine Jean-Pierre dijo que el Congreso estadounidense debe considerar legislar para abordar las imágenes falsas y abusivas que proliferan en línea.

Taylor Swift y Rosalía han sido víctimas de deepfake

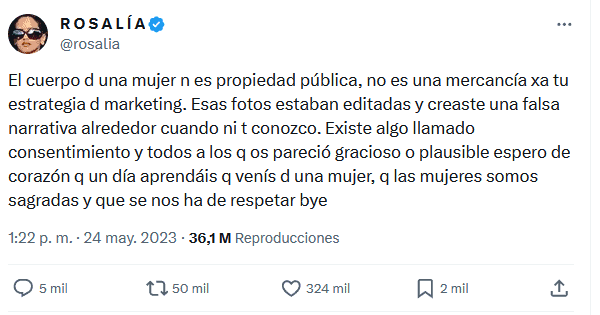

Otra cantante que fue víctima de deepfake es Rosalía. Con la declaración "Lo mejor que vas a ver hoy", el cantante JC Reyes compartió una imagen manipulada con Inteligencia Artificial de la cantante con el torso desnudo. Esta no fue la única ocasión, ya que horas después, el artista publicó otra imagen similar.

Rosalía respondió a esta vulneración de su intimidad a través de X, dijo que: “Ir a buscar clout (influencia) faltando el respeto y sexualizando a alguien es un tipo de violencia y da asco, pero hacerlo por 4 plays (visualizaciones) de más, lo que da es pena”. Y después añadió:

Twitter @rosalia

Combatir la violencia digital implica una acción coordinada en múltiples niveles: las plataformas digitales deben fortalecer sus medidas de seguridad y ofrecer mecanismos efectivos para denunciar y abordar el comportamiento abusivo, esto incluye las herramientas de Inteligencia Artificial.